Diseñar instrucciones para modelos de lenguaje ya no es un detalle técnico: es el factor que define si una aplicación de IA funciona… o falla.

De hablar con la IA a diseñarla

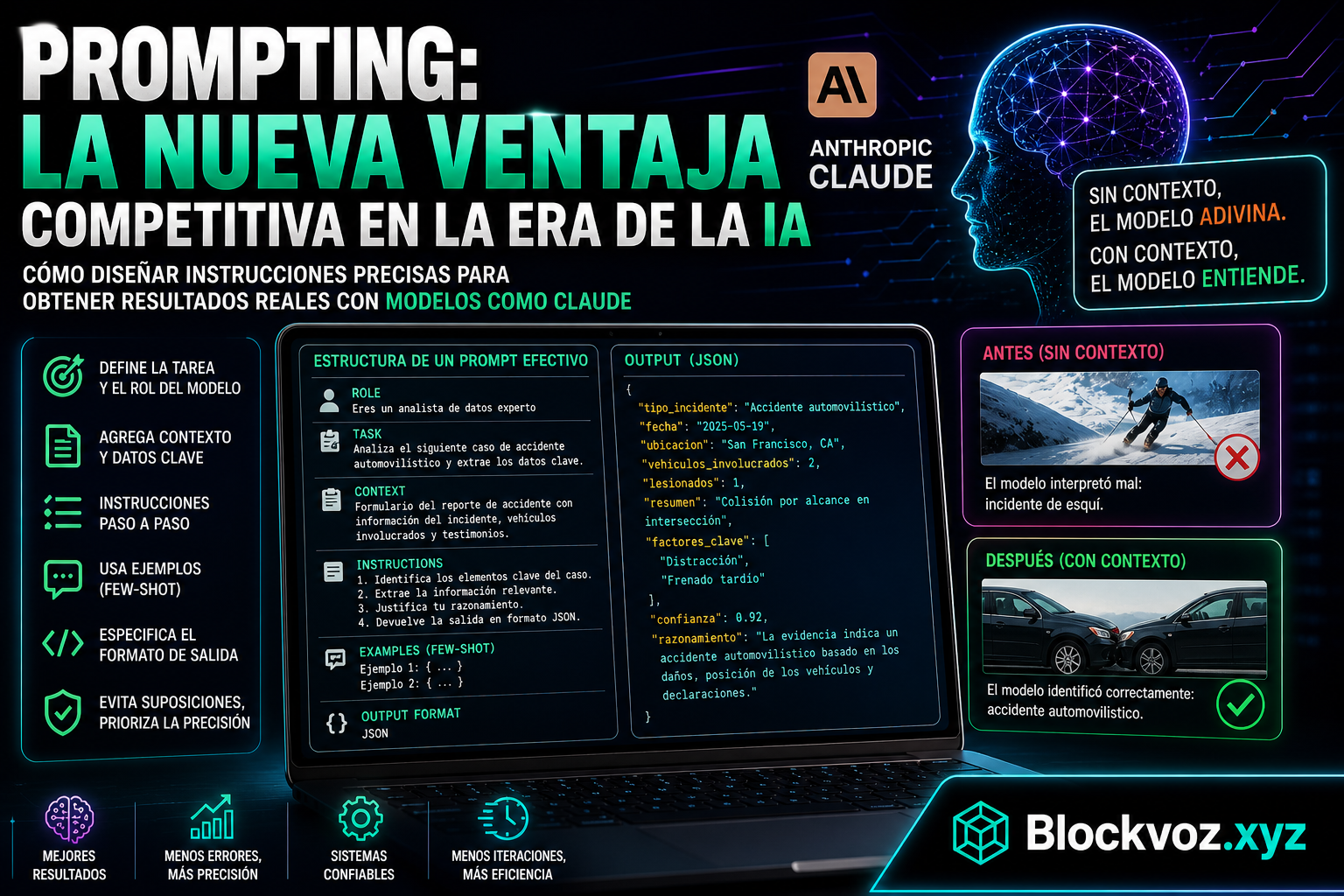

En la carrera por integrar inteligencia artificial en productos reales, una disciplina está marcando la diferencia: el prompting. No se trata de “hacer preguntas” a un chatbot, sino de diseñar instrucciones precisas para que modelos como Anthropic Claude interpreten correctamente tareas complejas y entreguen resultados útiles desde el primer intento.

Ese fue el foco de “Prompting 101”, una presentación del equipo de ingeniería aplicada de Anthropic en San Francisco, donde quedó claro algo clave: el problema muchas veces no es el modelo, sino cómo se le habla.

El error no es la IA, es el contexto

Uno de los ejemplos más reveladores mostró a un modelo analizando un accidente automovilístico… que terminó interpretando la escena como un incidente de esquí.

¿El fallo? Falta de contexto.

Cuando un modelo no recibe suficiente información, rellena los vacíos con suposiciones. Pero al añadir detalles claros —tipo de incidente, objetivo del análisis, estructura del formulario— el resultado cambia radicalmente: pasa de errores básicos a respuestas precisas y utilizables.

Aquí aparece un principio crítico:

si no hay suficiente información, el modelo no debería adivinar, sino reconocer la incertidumbre.

Cómo se construye un prompt efectivo

El prompting efectivo se parece más a escribir una especificación técnica que a tener una conversación. La estructura recomendada incluye:

- Definir el rol del modelo (qué es y qué debe hacer)

- Especificar la tarea concreta

- Incluir datos o inputs relevantes

- Dar instrucciones paso a paso

- Añadir ejemplos (few-shot prompting)

- Establecer reglas claras y formato de salida

Este último punto es clave en entornos productivos: no basta con una buena respuesta, debe venir en un formato utilizable (como JSON o estructuras predefinidas).

Menos intuición, más método

El aprendizaje central es importante, la calidad del output depende directamente de la calidad del prompt.

Según Dario Amodei, CEO de Anthropic, el futuro de la IA aplicada no solo pasa por modelos más avanzados, sino por cómo las empresas logran integrarlos de forma confiable en sus sistemas.

El prompting deja de ser una habilidad “nice to have” para convertirse en infraestructura crítica.

Por qué esto importa ahora

En entornos reales finanzas, salud, legal, operaciones no hay espacio para iterar cinco veces hasta obtener una buena respuesta. Los sistemas deben funcionar bien desde el inicio.

- Ya no se improvisa con prompts

- Se diseñan, prueban y optimizan como código

- Se convierten en activos estratégicos dentro de las empresas

El acceso a modelos avanzados se está democratizando. Pero eso también nivela el terreno.