Un estudio titulado “Large-Scale Online De-Anonymization with LLMs” advierte que modelos de lenguaje como GPT o Claude pueden vincular cuentas anónimas con identidades reales utilizando patrones de escritura y datos públicos.

El debate sobre privacidad digital y anonimato online se intensificó tras la difusión en X de un análisis del paper académico Large-Scale Online De-Anonymization with LLMs, desarrollado por investigadores de Anthropic, ETH Zurich y Mats.

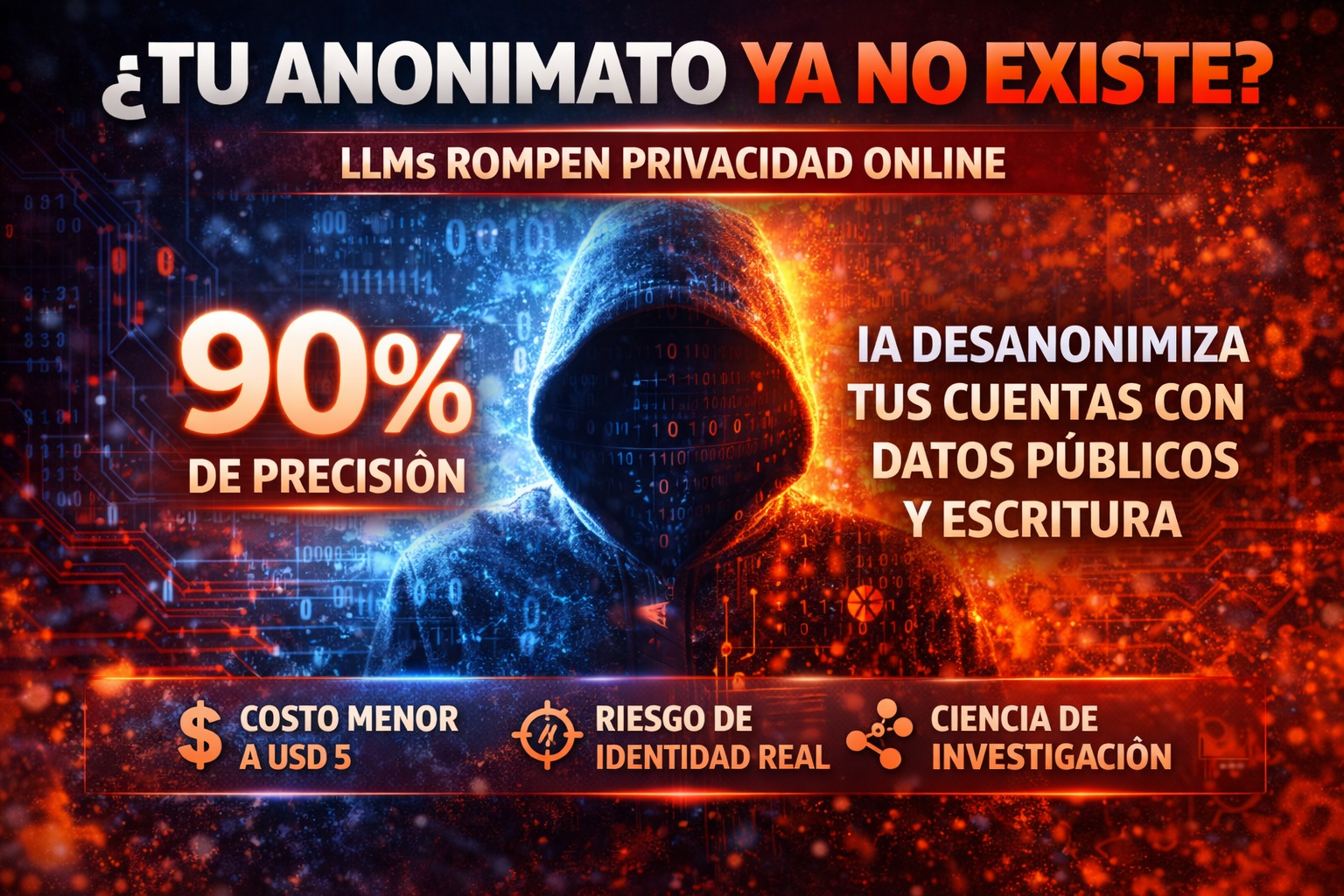

El estudio plantea un escenario inquietante: sistemas automatizados impulsados por modelos de lenguaje de gran escala (LLMs) serían capaces de identificar a usuarios detrás de cuentas anónimas con una tasa base de acierto del 67 %, y hasta 90 % de precisión cuando el sistema solo publica resultados de alta confianza.

¿Cómo funciona la desanonimización con inteligencia artificial?

Según el documento, el sistema desarrollado por los investigadores opera en cuatro etapas:

- Extrae señales de identidad a partir del estilo de escritura, intereses y patrones lingüísticos usando LLMs.

- Busca coincidencias mediante embeddings en grandes volúmenes de perfiles públicos.

- Razonamiento y ranking con modelos avanzados para evaluar probabilidades.

- Publica resultados solo cuando el nivel de certeza es elevado.

El proceso sería completamente automatizado y aplicable a plataformas como Reddit, Hacker News, LinkedIn e incluso transcripciones anonimizadas de entrevistas.

El costo de romper el anonimato online

Uno de los puntos más llamativos del estudio es el bajo costo estimado por objetivo: menos de 5 dólares en recursos computacionales y uso de APIs.

Esto sugiere que la desanonimización ya no sería un proceso exclusivo de agencias gubernamentales o hackers especializados, sino una posibilidad técnica accesible con herramientas comerciales de inteligencia artificial.

¿Murió el anonimato digital?

El paper concluye que los usuarios que mantienen nombres persistentes o patrones constantes de escritura deberían asumir que existe una probabilidad significativa de que sus identidades puedan ser vinculadas.

Además, el estudio advierte que incluso cuentas secundarias o “throwaways” podrían agruparse mediante análisis estilométrico y correlación de datos públicos.

Implicaciones para la ciberseguridad y la privacidad

El hallazgo plantea desafíos importantes para la protección de datos personales, la libertad de expresión y el diseño de plataformas digitales.

En un contexto donde los LLMs son cada vez más potentes y accesibles, la privacidad online deja de depender únicamente de la ausencia de filtraciones y pasa a estar ligada a la capacidad de los sistemas de inferir identidad a partir de patrones.

El debate ahora se traslada a reguladores, desarrolladores y usuarios: ¿cómo equilibrar innovación en inteligencia artificial con protección efectiva del anonimato digital?

Tu anonimato online se fue al carajo por menos de lo que cuesta un café

— Cisco | CryptoAlert (@CiscoCANFT) February 26, 2026

Y no gracias al FBI ni un hacker pro, basta con que alguien tenga acceso a un LLM potente (Claude, GPT, etc.) y unos cuantos posts tuyos viejos

Investigadores de Anthropic, ETH Zurich y Mats soltaron un… pic.twitter.com/dJcPgnUb9e